2020.01.09

ディープフェイクの危険性

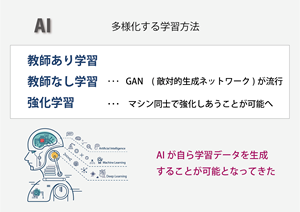

実際、すでに有名人の多くは被害にあっており、これは技術の進歩により、スマホなどでも手軽に動画や画像の加工ができるようになったことも影響しているようですが、教師なし学習の敵対的生成ネットワークのGANが利用されるようになってAI によってよりリアルな動画や画像加工ができるため、ファイクかどうかの見極めがしづらくなってきました。

GANを使用することにより、元にする画像にない仕草や表情まで作成できるため、喋っていない言葉を話す様子までリアルに近い映像を作成することができます。これが、

問題は、作成される画像や映像がリアルすぎて、本物かとうかをどのように判断するかということです。

上司からの指示かどうかも、ファイクではないかと疑い始めたらきりがないです。テレビ会議の向こう側で会話している人が、

今後、セキュリティ対策として、ディープフェイクをどのように対応すべきなのかも、企業として本気で取り組む必要がありそうです。

[タグ]

[関連]

前のページ

前のページ 次のページ

次のページ 元データが少ないとAIは学習できないのか?

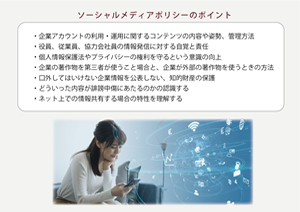

元データが少ないとAIは学習できないのか? ソーシャルメディアポリシーの厳守

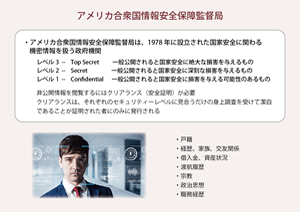

ソーシャルメディアポリシーの厳守 民間にも必要なセキュリティクリアランス

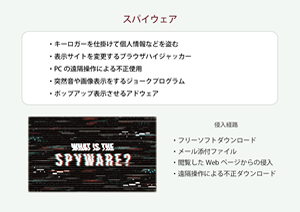

民間にも必要なセキュリティクリアランス 見極めが難しいスパイウェア

見極めが難しいスパイウェア